Mas leido

Building Stories

Modo Rua: Redefiniendo el desarrollo de aplicaciones mediante iteración centrada en el usuario Ago 23

Building Stories

NuStories: Adaptación de productos para clientes fanáticos en varios países Oct 30

Culture & Values

Cómo los valores y la cultura de Nu dan forma a los productos que creamos Ago 7

Carreras

Reunimos a grandes mentes de diversos orígenes que permiten la discusión y el debate y mejoran la resolución de problemas.

Conoce más sobre nuestras carreras

Autores: Daniel Braithwaite, Misael Cavalcanti y Hiroto Udagawa

El trabajo descrito aquí es un esfuerzo colaborativo de varios ingenieros de Nubank (en orden alfabético): Abhishek Shivanna, Arissa Yoshida, Austin McEver, Brian Zanfelice, Cristiano Breuel, Evan Wingert, Fabio Souza, Felipe Meneses, Helder Dias, Henrique Fernandes, Liam O’Neill, Marcelo Buga, y Matheus Ramos. También agradecemos a Rohan Ramanath, Daniel Silva y Guilherme Tanure por su apoyo.

Traducciones: Cinthia Tanaka y Kevin Rossell

Esta es la tercera parte de una serie de publicaciones en el blog sobre el modelado de las finanzas de los clientes a través de modelos fundacionales. Lee nuestra primera publicación en el blog para una introducción al problema. Revisa nuestra segunda publicación en el blog para más contexto sobre cómo formulamos nuestros modelos fundacionales para datos de transacciones.

En nuestras publicaciones anteriores sobre modelos fundacionales de clientes basados en transacciones, demostramos cómo el aprendizaje auto-supervisado (preentrenamiento) puede producir embeddings generales (no supervisados) que representan el comportamiento de un cliente a partir de datos de transacciones. Estos embeddings no están optimizados para ninguna tarea en particular y se pueden aplicar a una variedad de problemas. Sin embargo, si queremos lograr un rendimiento óptimo en una tarea específica, podemos refinar aún más el transformador y sus embeddings a través de un proceso llamado ajuste fino supervisado.

Nuestro proceso de ajuste fino supervisado es un paso secundario en el cual tomamos un modelo preentrenado y añadimos una capa lineal, llamada cabeza de predicción, para predecir la etiqueta dada, como una clasificación binaria, multi-clase o un objetivo de regresión. La entrada para esta cabeza de predicción es el embedding del token final, denominado embedding de usuario, a partir de la salida del transformador causal. Luego optimizamos el transformador simultáneamente con la capa de predicción para minimizar la pérdida (es decir, entropía cruzada, error cuadrático medio). Así, después del ajuste fino supervisado, las características de embedding están adaptadas a la tarea dada. La figura abajo (a la izquierda) muestra este proceso. Además, la figura a la derecha abajo muestra la mejora relativa del 1.68% en AUC lograda al ajustar finamente a través de varias tareas de referencia.

Uma motivação principal para o desenvolvimento de modelos fundacionais para dados de transações é capturar o sinal nesses dados de maneira mais eficaz através de uma codificação aprimorada (aprendida). Além disso, como visto em outros campos, hipotetizamos que à medida que escalamos esses modelos (por exemplo, mais histórico de transações, modelos maiores, mais dados), o sinal capturado dos dados de transações se tornará mais rico, levando a um desempenho ainda melhor em tarefas posteriores. Outro benefício desses modelos de fundação é que eles aliviam a necessidade de engenharia manual de features a partir dos dados de transações sequenciais. No entanto, nem todos os dados úteis são sequenciais. Na verdade, em muitos casos, os dados têm natureza tabular (por exemplo, informações de bureau), o que significa que precisamos de uma solução que nos permita incorporar tanto dados sequenciais quanto tabulares em uma solução final.

O processo de combinar embeddings com features tabulares é conhecido como fusão (ou blending). No restante deste post, discutimos sobre a fusão e, finalmente, introduzimos uma arquitetura que incorpora essas features no procedimento de ajuste fino do transformer. A abordagem trivial para a fusão é usar modelos de árvores de decisão impulsionadas por gradiente (GBT; por exemplo, XGBoost [2] ou LightGBM [3]), para combinar os dados tabulares, pois geralmente são considerados estado da arte [1]. Junto com essas features tabulares, embeddings ajustados podem ser passados para o treinamento do GBT, em um processo denominado fusão tardia [8]. No entanto, a fusão tardia é subótima porque os embeddings ajustados são aprendidos separadamente das features tabulares.

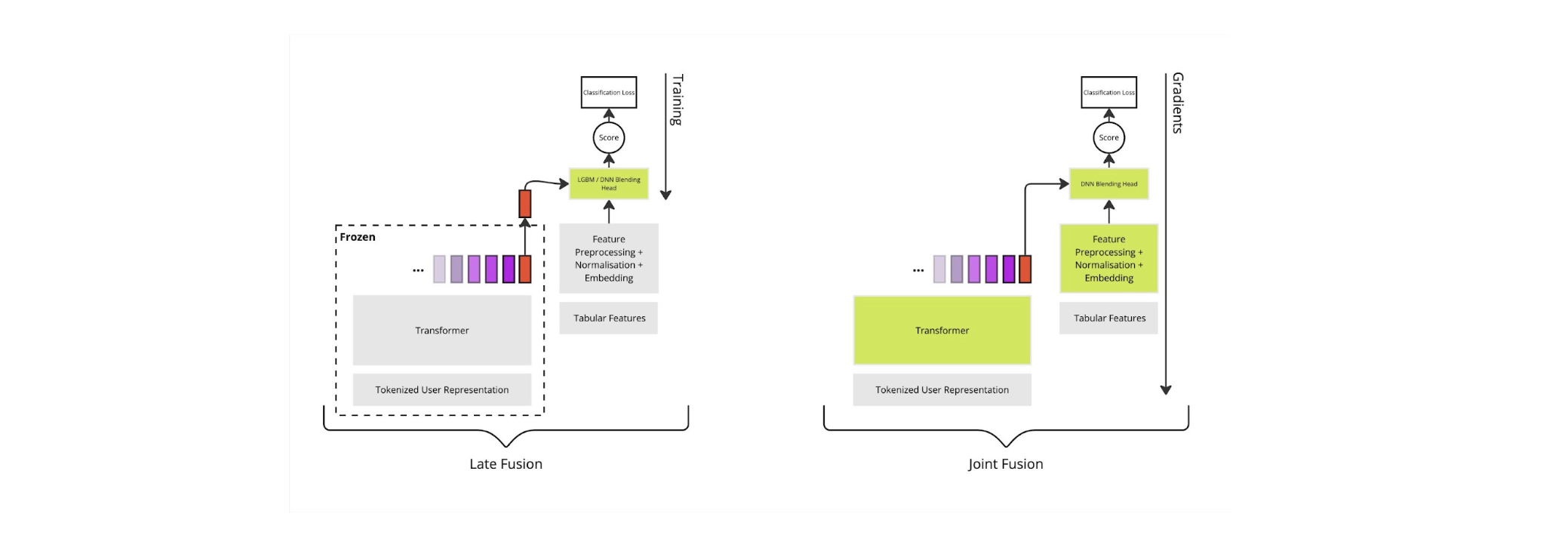

Em contraste com a fusão tardia, propomos um procedimento de treinamento baseado em fusão conjunta [8]. Este procedimento otimiza conjuntamente o transformer junto com o modelo de fusão, permitindo que o transformer capture melhor informações não presentes nas features tabulares. A figura abaixo mostra uma comparação de alto nível entre fusão tardia e fusão conjunta (os blocos verdes indicam quais seções do modelo são treinadas).

Infelizmente, os GBTs não são diferenciáveis e, portanto, são incompatíveis com a fusão conjunta. Motivados por essa incompatibilidade, investimos em redes de features tabulares baseadas em Redes Neurais Profundas (DNNs). No entanto, apesar de alguns trabalhos recentes mostrarem que DNNs podem ser competitivas com GBTs [4], o desempenho das redes de features tabulares baseadas em DNNs pode variar drasticamente entre problemas. Por exemplo, um artigo de revisão [5] avaliou 19 modelos de features tabulares (NN + GBT) em 176 conjuntos de dados, e cada modelo teve o melhor desempenho em um conjunto de dados e o pior em outro, tornando desafiador adotar uma abordagem única para todos.

O primeiro passo em nossa abordagem foi alcançar paridade entre DNNs e modelos GBT apenas nas features tabulares. Selecionamos a arquitetura DCNv2 [6], pois mostrou sucesso em problemas relacionados em grande escala (por exemplo, utilizada pelo Google [6]). No entanto, os resultados iniciais mostraram um desempenho muito pior (-0,40%) para os modelos DCNv2 baseados em DNNs em comparação com os GBTs.

Em um artigo recente [7], os autores descobriram que incorporar atributos numéricos como embeddings atingiu ganhos significativos ao modelar features tabulares numéricas em DNNs. Esses embeddings numéricos são construídos usando ativações periódicas em diferentes frequências aprendidas. Combinamos isso com tabelas de embeddings treináveis para também facilitar embeddings de features categóricas. Incorporar essa estratégia de embedding no modelo DCNv2 nos permitiu alcançar paridade com os GBTs em muitos de nossos problemas internos.

Apesar de alcançar paridade apenas com features tabulares, o último desafio a superar foi incorporar embeddings de usuários baseados em transformer nesses modelos, mantendo ou superando o desempenho do modelo GBT com DNNs. Três fatores-chave foram críticos para alcançar isso. Primeiramente, usamos o DCNv2 para processar as features tabulares incorporadas e projetar o resultado em um embedding de baixa dimensão. Esse embedding de features é concatenado com o embedding baseado em transformer, e um perceptron de múltiplas camadas faz a predição final. Em segundo lugar, adicionar regularização na forma de decaimento de peso e/ou dropout nas camadas cruzadas do DCNv2 reduziu o overfitting. Finalmente, adicionar normalização aos embeddings baseados em transformer melhorou a consistência do DCNv2, permitindo que o modelo de DNN consistentemente e de maneira confiável superasse os GBTs. A figura abaixo mostra a melhoria relativa média em AUC para uma coleção de tarefas de benchmark em várias versões de nosso modelo DNN. Vemos que somente ao combinar o DCNv2 com os embeddings numéricos somos capazes de superar o baseline.

Apesar dos desafios em usar DNNs com dados tabulares, conseguimos desenvolver um modelo que funciona bem para nossas tarefas atuais de interesse, utilizando uma combinação do DCNv2 [6], embeddings numéricos, embeddings de features categóricas [7] e regularização. Usando esse modelo DCNv2 com as melhorias mencionadas, podemos treinar o modelo de fusão para combinar features e embeddings enquanto simultaneamente ajustamos o modelo transformer. A figura abaixo mostra a fusão de features tabulares como parte do processo de ajuste fino. A figura à direita abaixo mostra o pré-processamento e embedding de features tabulares em mais detalhes.

En la siguiente figura, visualizamos la ganancia relativa en AUC al usar fusión conjunta versus fusión tardía en las mismas tareas de referencia mencionadas arriba. Como antes, el modelo de referencia aquí es un modelo LightGBM entrenado solo con las características. Esto demuestra la ventaja de afinar conjuntamente con características tabulares. Es importante destacar que, en el caso de tanto la fusión tardía como la fusión conjunta, la mejora no se obtiene añadiendo nuevas fuentes de información. Más bien, la mejora se logra aprendiendo automáticamente características informativas para la tarea en cuestión al afinar nuestros modelos fundacionales de transacciones.

En esta publicación del blog, comenzamos motivando e introduciendo un enfoque estándar de ajuste fino supervisado para aprender embeddings que están adaptados a tareas específicas. Posteriormente, introducimos la fusión conjunta, que nos permite combinar conjuntos de características tabulares existentes con nuestros embeddings durante el ajuste fino. La fusión conjunta facilita proporcionar una mejora en el rendimiento a partir de nuestros embeddings de usuario al mismo tiempo que se incorpora cualquier solución existente basada en características tabulares. Finalmente, demostramos la mejora generada por la fusión conjunta en benchmarks internos.

Resumen de la serie

Si llegaste hasta aquí, te invitamos a revisar el resto de la serie de blogs para obtener más contexto y profundidad técnica sobre este enfoque.

Descubre las oportunidades

References

[1] Borisov, V., Leemann, T., Seßler, K., Haug, J., Pawelczyk, M., & Kasneci, G. (2022). Deep neural networks and tabular data: A survey. IEEE transactions on neural networks and learning systems.

[2] Chen, T., & Guestrin, C. (2016, August). Xgboost: A scalable tree boosting system. In Proceedings of the 22nd acm sigkdd international conference on knowledge discovery and data mining (pp. 785-794).

[3] Ke, G., Meng, Q., Finley, T., Wang, T., Chen, W., Ma, W., … & Liu, T. Y. (2017). Lightgbm: A highly efficient gradient boosting decision tree. Advances in neural information processing systems, 30.

[4] Zabërgja, G., Kadra, A., & Grabocka, J. (2024). Tabular Data: Is Attention All You Need?. arXiv preprint arXiv:2402.03970.

[5] McElfresh, D., Khandagale, S., Valverde, J., Prasad C, V., Ramakrishnan, G., Goldblum, M., & White, C. (2024). When do neural nets outperform boosted trees on tabular data?. Advances in Neural Information Processing Systems, 36.

[6] Wang, R., Shivanna, R., Cheng, D., Jain, S., Lin, D., Hong, L., & Chi, E. (2021, April). Dcn v2: Improved deep & cross network and practical lessons for web-scale learning to rank systems. In Proceedings of the web conference 2021 (pp. 1785-1797).

[7] Gorishniy, Y., Rubachev, I., & Babenko, A. (2022). On embeddings for numerical features in tabular deep learning. Advances in Neural Information Processing Systems, 35, 24991-25004.

[8] Imrie, F., Denner, S., Brunschwig, L. S., Maier-Hein, K., & Van Der Schaar, M. (2025). Automated ensemble multimodal machine learning for healthcare. IEEE Journal of Biomedical and Health Informatics.

Descubre las oportunidades